Não são apenas as pandemias o risco catastrófico global que ameaçam a vida humana, alguns são riscos novos, que nós mesmos estamos produzindo, tal como o aquecimento global, guerras nucleares e a inteligência artificial. Outros, são tão antigos quanto o planeta, tal como erupções de mega-vulcões ou a queda de um asteroide similar ao que levou a extinção dos dinossauros.

Se por um lado ainda estamos pouco preparados para esses desafios, por outro já não é mais impossível resistir as enormes forças do planeta e do cosmos.

Índice

Pensando o risco catastrófico global

Para além de uma possível futura nova pandemia, existem outros desafios, com maior ou menor grau de risco catastrófico global.

Como pensar esse risco? Trata-se de uma área altamente especulativa.

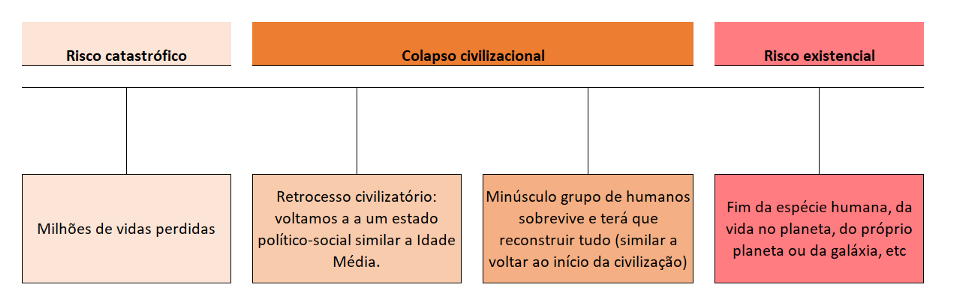

No gráfico abaixo, usamos a nomenclatura que cientistas e filósofos geralmente dão a classificação destes problemas. Porém, para sermos didáticos e aproximarmo-nos psicologicamente do que queremos que tenha em mente aqui, sugerimos imaginar, “de brincadeira”, uma escala que iria do “muito, muito ruim” ao “tão terrível que mal dá para botar em palavras”.

Alguns cenários também poderiam impactar não somente o colapso civilizacional como também uma dificuldade extra em sua “reconstrução”. Por exemplo, uma guerra nuclear total poderia nos mandar de volta a um nível de desenvolvimento equivalente ao da Idade Média. Isso já seria terrível por si só.

Podemos imaginar também que, dado um legado cultural de desconfiança causado por esta guerra, seria muito mais difícil recriar a cooperação entre coletividades nesse futuro hipotético, além de projetar que terríveis condições climáticas tornariam a terra arável disponível muito inferior a atual ou uma drástica perda de biodiversidade, tornando o futuro avanço da civilização muito mais complicado.

Os principais riscos catastróficos globais

De fato, não são as coisas mais agradáveis de se ficar pensando. Porém, se você nos acompanhou até aqui, acreditamos que você provavelmente seja uma pessoa que prefere agir para resolver problemas e não se paralisa diante de desafios.

Sendo assim, passaremos a analisar alguns destes principais riscos catastróficos globais e, na última parte, o que está em nossas mãos, inclusive nas suas, para detê-los.

Guerra nuclear

As armas nucleares que encontram-se hoje ativas têm o potencial de matar centenas de milhões de pessoas diretamente e bilhões devido aos seus efeitos subsequentes na agricultura. Elas apresentam alguma medida de risco (ainda desconhecido) de extinção humana pelo potencial de um “inverno nuclear” e de um colapso social do qual podemos nunca nos recuperar.

Embora os efeitos iniciais de tais bombas nucleares fossem horríveis, os efeitos posteriores poderiam ser piores. Uma guerra nuclear poderia causar um inverno nuclear — uma liberação de fuligem na atmosfera, bloqueando a energia térmica do Sol e baixando as temperaturas, regional e globalmente, por vários anos, abrindo novos buracos na camada de ozônio que protege a Terra da radiação prejudicial, reduzindo precipitação global em cerca de 10%, desencadeando falhas nas colheitas e resultando em escassez generalizada de alimentos. No entanto, ainda há controvérsias sobre se os efeitos de um inverno nuclear seriam apenas ruins ou uma completa catástrofe e quantas armas nucleares teriam que ser detonadas para que efeitos climáticos de longa duração fossem acionados.

Há muitos exemplos na história de momentos em que os EUA ou a Rússia chegaram perto de usar suas armas nucleares, acidentalmente ou deliberadamente. (Leia a análise sobre Segurança Nuclear aqui).

Com o fim da Guerra Fria, tal preocupação tem ficado cada vez mais em segundo plano no imaginário das pessoas. Isso na verdade torna o problema ainda mais preocupante pois pode estar contribuindo para torná-lo ainda mais negligenciado. Afinal, não é como se tivéssemos superado os riscos apontados.

Aquecimento global

De acordo com as estimativas atuais, as emissões de gases de efeito estufa, caso não sejam mitigadas, provavelmente levarão a aumentos da temperatura global de 2,6ºC a 4,8ºC até 2100. Se isso acontecer, é possível que ocorrão males humanitários significativos, incluindo condições meteorológicas mais severas, crises alimentares e disseminação de doenças infecciosas que afetariam desproporcionalmente as pessoas em piores condições.

Além disso, há o risco catastrófico global, não desprezível, de que emissões não mitigadas levem a aumentos ainda maiores nas temperaturas globais, cujos resultados poderiam ser calamitosos para a vida na Terra. Embora a chance de grandes aumentos seja relativamente baixa, o grau de dano que resultaria deste cenário é muito alto e, por isso, não pode ser desprezado (leia a análise completa aqui).

Por fim, tal como mencionamos em outra proposta, a combinação de desmatamento + aquecimento global contribui para a migração de espécies para novos locais (dada a alteração dos ecossistemas) e assim aumentam o risco de transmissão zoonótica de novas doenças, ou seja, de doenças que migrem de uma espécie para outra espécie, inclusive para o homem, animais de estimação e rebanhos.

Inteligência Artificial (IA)

Por volta de 1800, a civilização passou por uma das mudanças mais profundas da história humana: a revolução industrial. Este não foi o primeiro evento desse tipo — a revolução agrícola transformou vidas humanas 12 mil anos antes. Um crescente número de especialistas acredita que uma terceira revolução ocorrerá durante o século XXI, pela invenção de máquinas com inteligência que supera em muito a nossa.

O rápido progresso no “aprendizado de máquina” (machine learning) elevou a perspectiva de que os algoritmos um dia serão capazes de realizar a maioria ou todas as tarefas mentais realizadas atualmente por humanos. Isso poderia nos levar a máquinas que são muito melhores nessas tarefas do que nós.

Essa pode ser a transição mais importante do próximo século — podendo tanto inaugurar uma era de riqueza e progresso sem precedentes ou sendo o prenúncio de um desastre. Mas também é uma área altamente negligenciada: enquanto bilhões são gastos tornando a IA mais poderosa, estimamos que menos de 100 pessoas no mundo estão trabalhando em como tornar a IA mais segura.

Esses avanços podem levar a desenvolvimentos extremamente positivos, apresentando soluções para problemas globais atualmente intratáveis. Tais sistemas poderiam nos ajudar a progredir rapidamente na cura de doenças ou a projetar robôs para atender às necessidades humanas, por exemplo. Contudo, também apresentam riscos graves.

Alguns se preocupam com os efeitos sociais disruptivos desse tipo de inteligência de máquina e, em particular, com sua capacidade de assumir trabalhos anteriormente feitos por trabalhadores menos qualificados. Se a economia for incapaz de criar novos empregos para essas pessoas com rapidez suficiente, haverá desemprego generalizado e queda nos salários. Esses resultados poderiam ser evitados por meio de políticas governamentais, mas isso exigiria um planejamento significativo.

Contudo, um problema talvez muito maior seja aquele relativo ao alinhamento de objetivos. Tudo que se faz necessário é que uma única máquina superinteligente no mundo receba uma instrução mal-elaborada para termos um grande risco em mãos. Quanto mais inteligente for um sistema, mais difícil será para os humanos exercerem uma supervisão significativa. E, como no cenário acima, uma máquina inteligente poderia desejar manter os humanos no escuro, se ocultar suas ações reduz o risco de que os humanos interfiram no alcance da meta que lhe foi colocada. (Leia a análise completa deste problema aqui).

Entendemos que os riscos relacionados à Inteligência Artificial são reais, urgentes e não podem ser ignorados. De todo modo, há também diversos argumentos contrários a ver esse como um problema urgente ou real: alguns argumentam que uma inteligência de máquina além das capacidades humanas está muito distante, outros, que a inteligência artificial, mesmo que seja muito mais inteligente do que os seres humanos em alguns aspectos, nunca terá a oportunidade de causar destruição em escala global. E há também aqueles que acreditam que será muito fácil fazer com que o sistema inteligente aja de acordo com nossos interesses.

Como contraponto, sugerimos a leitura desse texto por Steven Pinker, em seu livro o Novo Iluminismo, no qual analisa os riscos associados à Inteligência Artificial e conclui que são em maior parte quiméricos. Para uma leitura mais avançada de debates e contrapontos recomendamos também os links a seguir (em inglês, ainda não traduzido — Fonte 1, Fonte 2, Fonte 3)

Outras sugestões de leitura:

- Os Maiores Mitos sobre a Inteligência Artificial

- Fundamentos para considerar a Inteligência Artificial (IA) como uma ameaça séria à humanidade

O que você pode fazer para ajudar nestes problemas?

Primeiramente, para você que é universitário ou que está considerando mudanças significativas em sua carreira, recomendamos dar início ao guia de carreiras 80.000 horas, traduzido totalmente para o português.

Uma pessoa trabalha em média 80.000 horas ao longo de sua vida, e este guia tenta lhe ajudar em uma questão simples: qual a melhor maneira de gastar estas horas para ajudar a resolver os problemas mais urgentes do mundo?

Atue para evitar o risco catastrófico global

Dentre as principais áreas possíveis para atuação muitas são justamente relativas aos riscos catastróficos globais que aqui mencionamos, tal como a biosegurança (ajudando assim a prevenir o “próximo corona”) o aquecimento global, a segurança nuclear e a inteligência artificial. Nestes artigos, você encontrará diversas sugestões de que carreiras seguir, específicas a cada um dos problemas.

Algumas abordagens menos convencionais para mitigar os riscos catastróficos de modo geral poderiam envolver melhorar a resiliência de nosso suprimento de alimentos no caso de um sério colapso agrícola.

Agora, caso você deseje fazer uso de seu dinheiro no combate direto a esse problema, considere realizar doações para organizações voltadas ao combate aos riscos catastróficos gerais. Para o melhor uso de seu dinheiro, sugerimos doações para o Long-Term Future Fund, gerido pela comunidade do Altruísmo Eficaz internacional. Esse fundo recebe doações de pessoas como eu, você e doadores de todo resto do mundo e então canaliza esses recursos as medidas mais eficazes na redução dos riscos catastróficos globais.

Por fim, divulgue. Converse com as pessoas sobre todo material sendo debatido neste guia. Escreva para seu blog, divulgue esse post em suas redes sociais. A humanidade se tornará mais resiliente aos riscos tão somente se mais pessoas estiverem cientes do que deve ser feito.

Este artigo faz parte da série: “Coronavírus: o que fazer para nunca mais acontecer”.