Vídeo e transcrição da apresentação sobre introdução à governança computacional

Nesta palestra, apresento a ideia de usar recursos computacionais (short compute) como um nó para a governança da IA. Primeiro, começarei falando sobre eventos recentes em poder computacional e IA e como eles se relacionam com a governança computacional.

Em fevereiro de 2023, fiz uma introdução à Governança Computacional como parte de uma série de palestras que dei em think tanks. Todas as ideias estão evoluindo um pouco, especialmente o que conta como propriedades fundamentais. No entanto, acho que estou apontando na direção certa aqui. A gravação está disponível aqui .

Índice

Linhas gerais

Nesta palestra, apresento a ideia de usar recursos computacionais (short computing) como um nó para a governança da IA. Primeiro, começarei falando sobre eventos recentes em poder computacional e IA e como eles se relacionam com a governança computacional. Em seguida, discutirei as propriedades únicas e o estado de coisas em termos de poder computacional que o tornam um nó particularmente governável para a governança da IA e como isso se relaciona com a cadeia de suprimentos do poder computacional e outros conceitos. Posteriormente, exploraremos a ideia de mecanismos capacitados por hardware e como eles podem ser usados para fornecer garantias e outros objetivos de governança da IA. Por último, apresentarei o nosso trabalho em políticas e encerrarei com um resumo.

Resumo

Esta palestra oferece uma visão geral ampla do estado da governança computacional. A importância do poder computacional para treinar sistemas de IA é cada vez mais reconhecida, e vários processos de governança já estão a caminho, com destaque para as restrições dos EUA sobre semicondutores e ferramentas de produção.

O poder computacional tem três propriedades fundamentais. Primeiro, é excluível, o que significa que só pode ser usado por um ator de cada vez. Em segundo lugar, devido à sua natureza física, é quantificável, o que significa que se pode medir com segurança a quantidade de poder computacional que um ator possui e utiliza. E terceiro, é necessário: não se podem executar aplicativos de IA sem poder computacional.

Além disso, destaco a situação atual do poder computacional, que se caracteriza pela grande extensão de infraestrutura física necessária para a produção e operação, cadeias de suprimentos complexas e a necessidade de conhecimento tácito para produzi-lo. Juntamente com as propriedades fundamentais, isso torna o poder computacional governável.

Seguindo em frente, proponho três estratégias principais para a governança computacional:

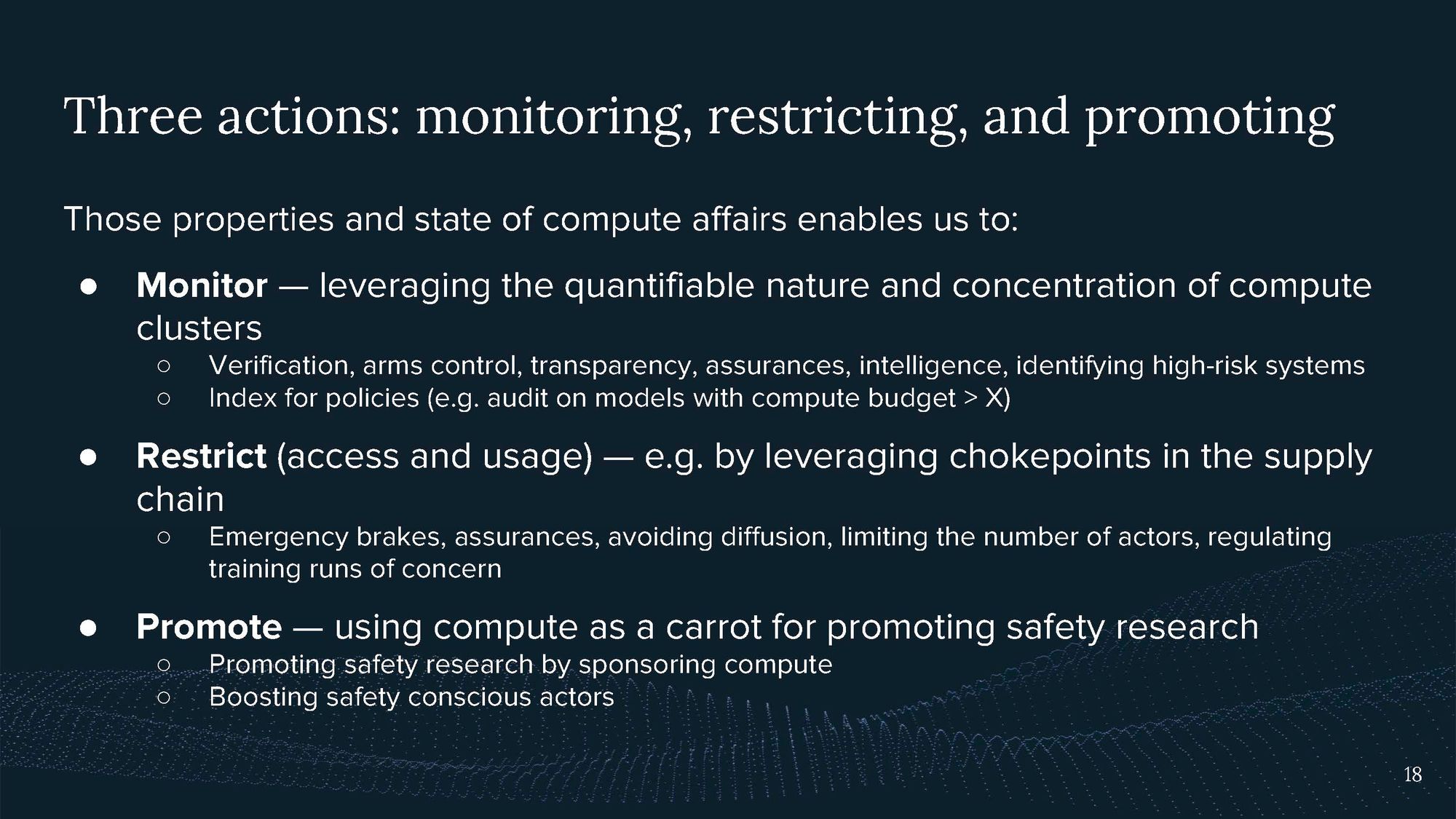

- Monitoramento do uso do poder computacional: ao aproveitar a natureza quantificável do poder computacional, podemos rastrear o uso e identificar sistemas potencialmente de alto risco.

- Restrição do uso de poder computacional: a propriedade do poder computacional de ser excluível permite a possibilidade de negar acesso a determinados recursos. Exemplos recentes disso incluem as restrições de exportações de chips de IA pelos EUA.

- Promoção do uso de poder computacional: em contraste com a restrição, esta estratégia envolve fornecer acesso subsidiado a recursos. O objetivo aqui seria permitir o uso responsável e a pesquisa sobre medidas de segurança.

A governança computacional não se trata principalmente de restringir o acesso; também pode permitir a diplomacia capacitada pelo hardware, p. ex., fazendo afirmações verificáveis sobre o uso de poder computacional. Isso pode exigir futuros mecanismos baseados em hardware que estão sujeitos a pesquisas contínuas.

Eu defendo que a propriedade do poder computacional implica responsabilidade, especialmente devido à sua natureza de uso duplo. Quanto mais poder computacional alguém possuir, mais capazes serão os sistemas de IA que poderão ser treinados e maiores serão os danos que poderão ser causados.

Por último, enfatizo que a governança computacional não pode ser uma solução independente, mas deve ser vista como uma ferramenta para um amplo conjunto de regimes de governança da IA.

Transcrição

Olá pessoal. Meu nome é Lennart Heim e hoje darei uma visão geral do uso da infraestrutura computacional como um nó para governança da IA.

Trabalho no Centre for the Governance of AI como pesquisador com foco em governança computacional. Tenho experiência em hardware de computador proveniente de meus estudos e empregos anteriores, onde aprendi como os computadores funcionam até o nível dos bits. Meu trabalho atual está dividido entre questões estratégicas e técnicas sobre governança computacional.

Estou pensando em questões como: qual é defesa para a governança computacional? Que intervenções seriam possíveis? Além disso, faço parte da equipe de políticas do GovAI, juntamente com Jonas Schütt e Markus Anderljung, transformando a nossa investigação em propostas de diretrizes políticas.

Paralelamente, recentemente ajudei a lançar a Epoch , investigando tendências empíricas no aprendizado de máquina e prevendo avanços em IA. Lá, estou principalmente envolvido em me comunicar com as partes interessadas e informar pesquisas em andamento sobre governança.

A governança computacional ainda é um campo incipiente, e tentarei apresentar algumas reflexões e conceitos iniciais sobre como estou pensando sobre o poder computacional. Minha palestra seguirá estes pontos:

Eu vou:

- Discutir os eventos recentes relacionados à governança computacional.

- Explorar as propriedades fundamentais e a importância do poder computacional como um nó para a governança da IA.

- Apresentar conceitos para o governo do poder computacional.

- Examinar possíveis mecanismos para a governança computacional além das restrições à exportação.

- Compartilhar minhas ideias sobre estratégias e políticas relacionadas à governança computacional.

1. Recentemente, na Governança Computacional

Em setembro de 2022, os EUA anunciaram novas restrições à exportação de chips de IA, software de design de chips, fabricação avançada de chips e equipamentos de fabricação de semicondutores. O país também restringiu o apoio de cidadãos dos EUA ao desenvolvimento de chips na China.

Essa medida visa limitar o desenvolvimento da IA relacionado com violações dos direitos humanos, como, por exemplo, a utilização de visão computacional para a vigilância, conforme estabelecido na explicação. (Mais sobre controles de exportações posteriormente)

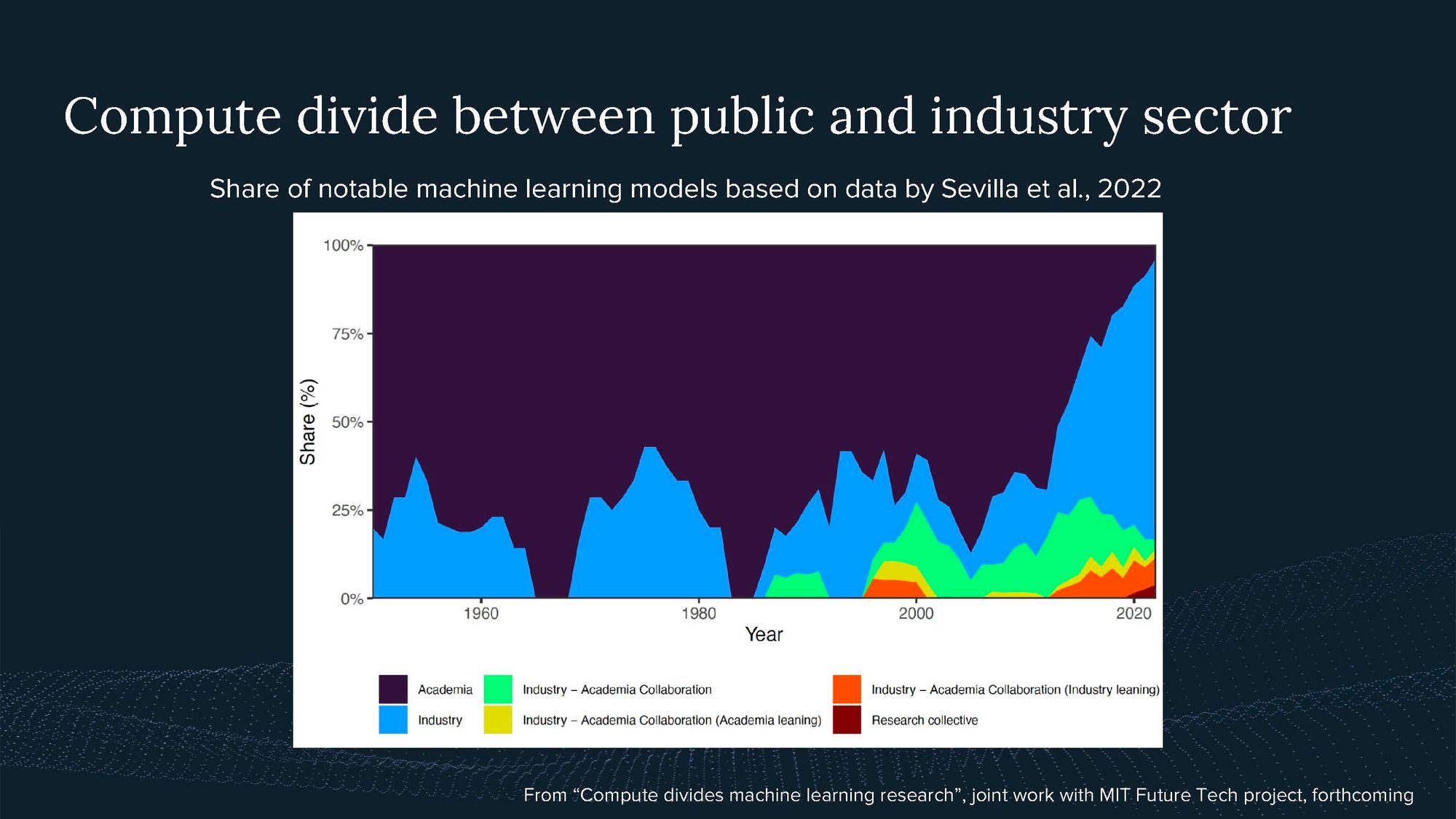

Ao mesmo tempo, está surgindo um divisor crescente no acesso ao poder computacional de IA entre o setor público, o meio acadêmico e a indústria. Modelos notáveis de aprendizado de máquina são cada vez mais desenvolvidos pela indústria, potencialmente devido à falta de recursos computacionais na academia.

Vemos os primeiros esforços políticos para resolver esse divisor computacional, como o National AI Research Resource (NAIRR), tentando estabelecer um grande cluster computacional para permitir a investigação acadêmica nos EUA. O grupo de especialistas em computação da OCDE do qual faço parte também analisa o divisor computacional entre países.

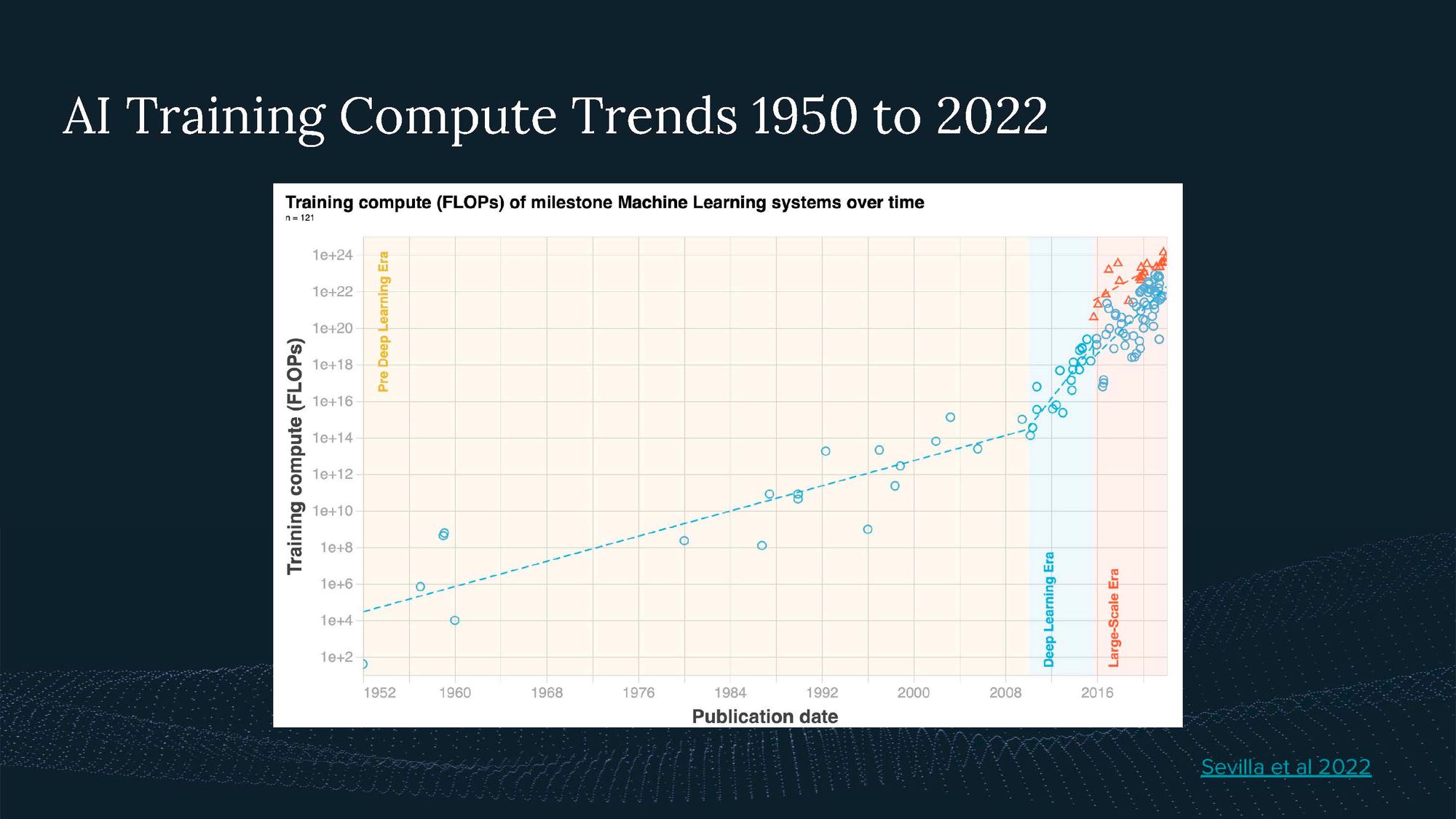

Parcerias estratégicas entre fornecedores de poder computacional, como empresas de nuvem e laboratórios de IA, destacaram a importância da infraestrutura computacional no desenvolvimento de IA. A demanda por poder computacional em sistemas de IA tem crescido rapidamente, sendo que a utilização duplica a cada seis meses.

A principal tendência aqui é que os modelos continuem a ficar cada vez maiores, como demonstramos numa análise recente.

Tudo isso mostra que existem janelas de oportunidade para influenciar a forma como poder computacional é utilizado. Mas, apesar da crescente relevância da governança computacional, atualmente há pesquisas e insights limitados nesta área. O meu objetivo é encorajar um pensamento mais estratégico e melhores decisões políticas para garantir resultados benéficos da IA.

2. Teorizando a Governança Computacional

Agora, quero discutir alguns conceitos de governança computacional, com foco em onde e como podemos governar o poder computacional.

A primeira maneira de pensar sobre o poder computacional é como parte da tríade da IA:

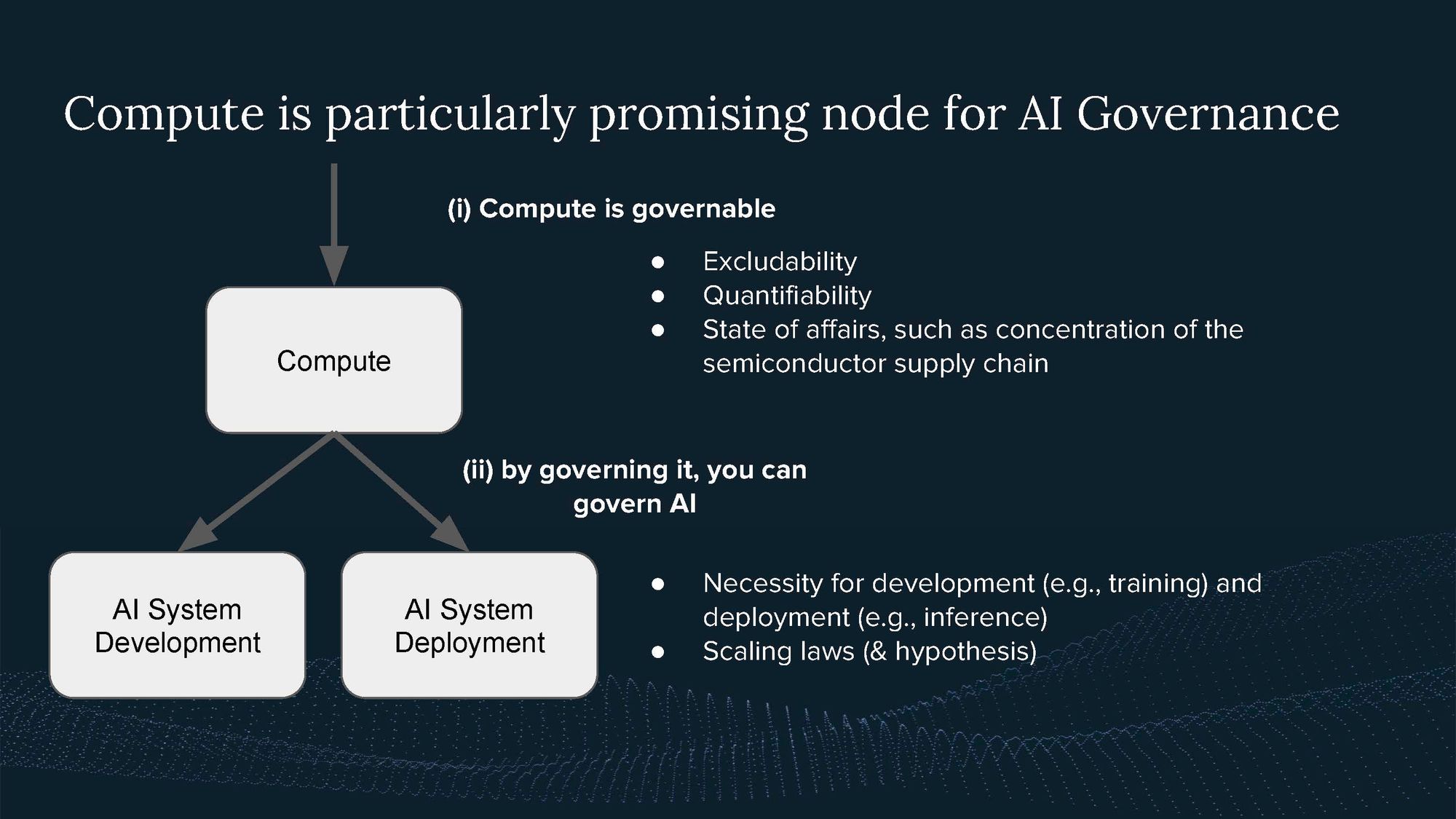

O poder computacional pode representar uma contribuição particularmente governável para a IA em comparação com algoritmos e dados.

Isso se deve às suas Propriedades Fundamentais .

1. Excluibilidade

Seu computador só pode executar um determinado número de programas por vez. Em todo o hardware do mundo, você só pode executar alguns cálculos. Isso significa que todos não podem usá-lo simultaneamente. O poder computacional é, portanto, um recurso excluível. Você pode restringi-lo, p. ex., por meio de computação em nuvem ou controles de exportações. (Isso é fundamentalmente diferente para algoritmos e dados, que podem ser copiados ilimitadamente quando se tornam públicos.)

2. Quantificabilidade

O poder computacional tem uma natureza física e você pode “contá-lo”. Você pode especificar a sua configuração do hardware ou quanta energia está usando.

3. Necessidade

De quanto você precisa depende da aplicação que deseja executar, mas você definitivamente precisa de algum hardware para executar seu programa.

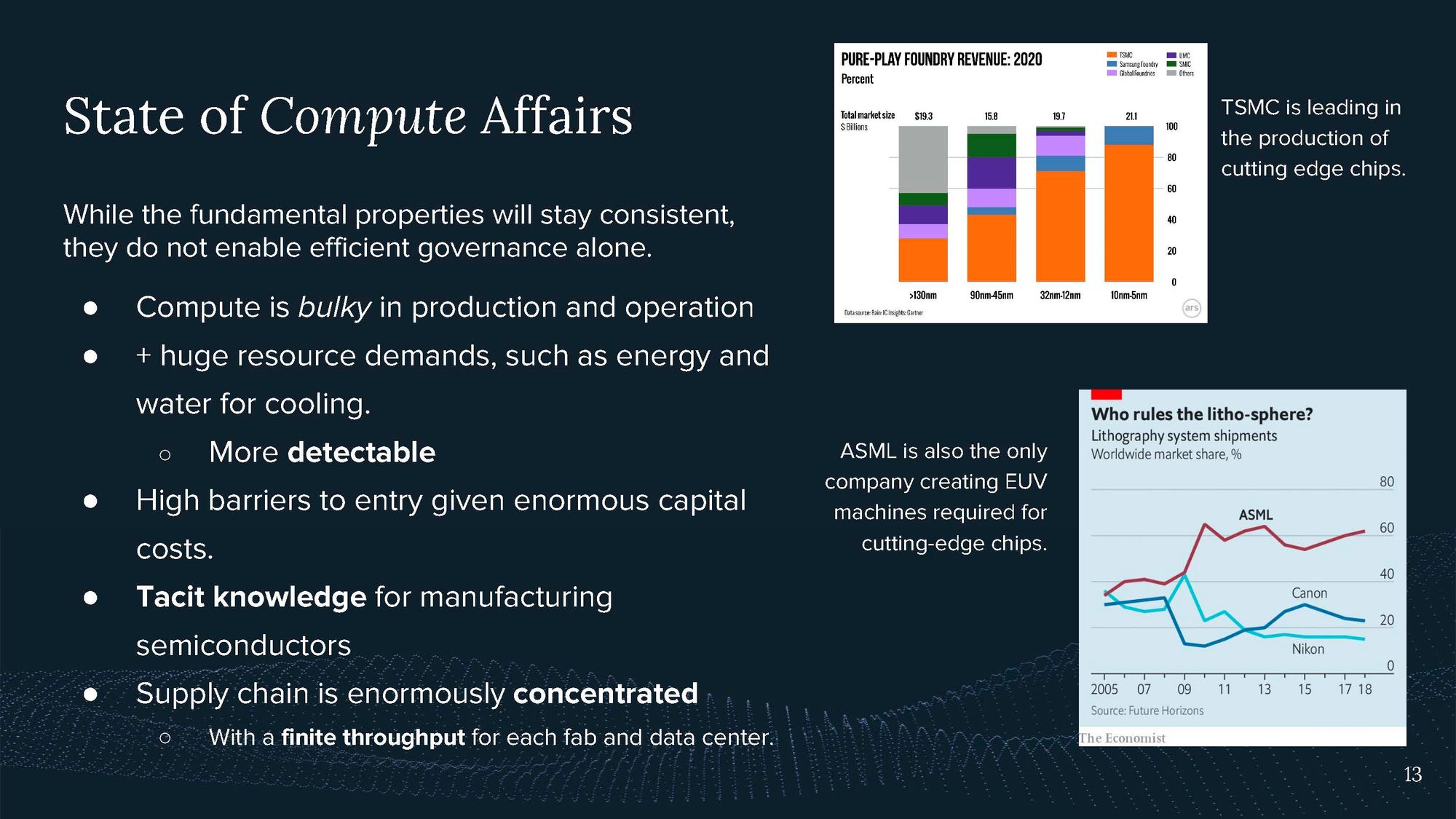

Essas são as propriedades fundamentais que dificilmente mudarão. Mas essas propriedades em si ainda não dizem muito sobre quão difícil é governar o poder computacional. Então, vamos dar uma olhada em como está o cenário da computação hoje. Vamos dar uma olhada no estado de coisas computacionais.

O que há de especial no poder computacional?

- É volumoso: você precisa de grandes quantidades para treinar IA e, para alimentá-la, precisa de espaço e muita energia.

- A cadeia de suprimentos é incrivelmente complexa e possui diversas concentrações.

- Existe um conhecimento tácito: mesmo que você tivesse todas as máquinas necessárias para produzir chips de última geração, não seria capaz de usá-las porque é necessária muita expertise para operá-las.

- A TSMC e a ASML são dois atores e gargalos principais na cadeia de suprimentos.

Os chips de IA são a tecnologia mais complexa que a humanidade já criou. São necessárias décadas de inovação e uma sofisticada cadeia de suprimentos global para produzi-los.

As propriedades fundamentais que apresentei, juntamente com o estado de coisas atual, tornam o poder computacional um input governável para a IA. Mas isso pode mudar à medida que a situação muda. Por exemplo, a cadeia de suprimentos poderá ser mais distribuída no futuro ou o treinamento de IA poderá exigir muito menos hardware.

Ao governar o poder computacional, você pode governar a IA. Tanto o seu desenvolvimento como a sua implementação.

3. Conceitos para a Governança Computacional

Existem três ações principais que podemos realizar: monitorar, restringir e promover o uso do poder computacional.

A monitorização aproveita a natureza quantificável e a concentração do poder computacional para a verificação, o controle de armas, a transparência e a identificação de sistemas de alto risco. A restrição do uso do poder computacional pode ser feita aproveitando pontos de estrangulamento na cadeia de suprimentos, como negar acesso a serviços em nuvem ou reter o acesso a chips de IA, como visto em recentes controles de exportações. Isso poderia ser usado para excluir maus atores ou potencialmente acionar freios de emergência. Por outro lado, a promoção da utilização do poder computacional pode encorajar a investigação sobre segurança da IA ou apoiar o meio acadêmico, fornecendo acesso subsidiado a recursos computacionais. É o que acontece com o recurso nacional de investigação dos EUA (NAIRR). Idealmente, isso poderia permitir de forma diferenciada a pesquisa sobre segurança.

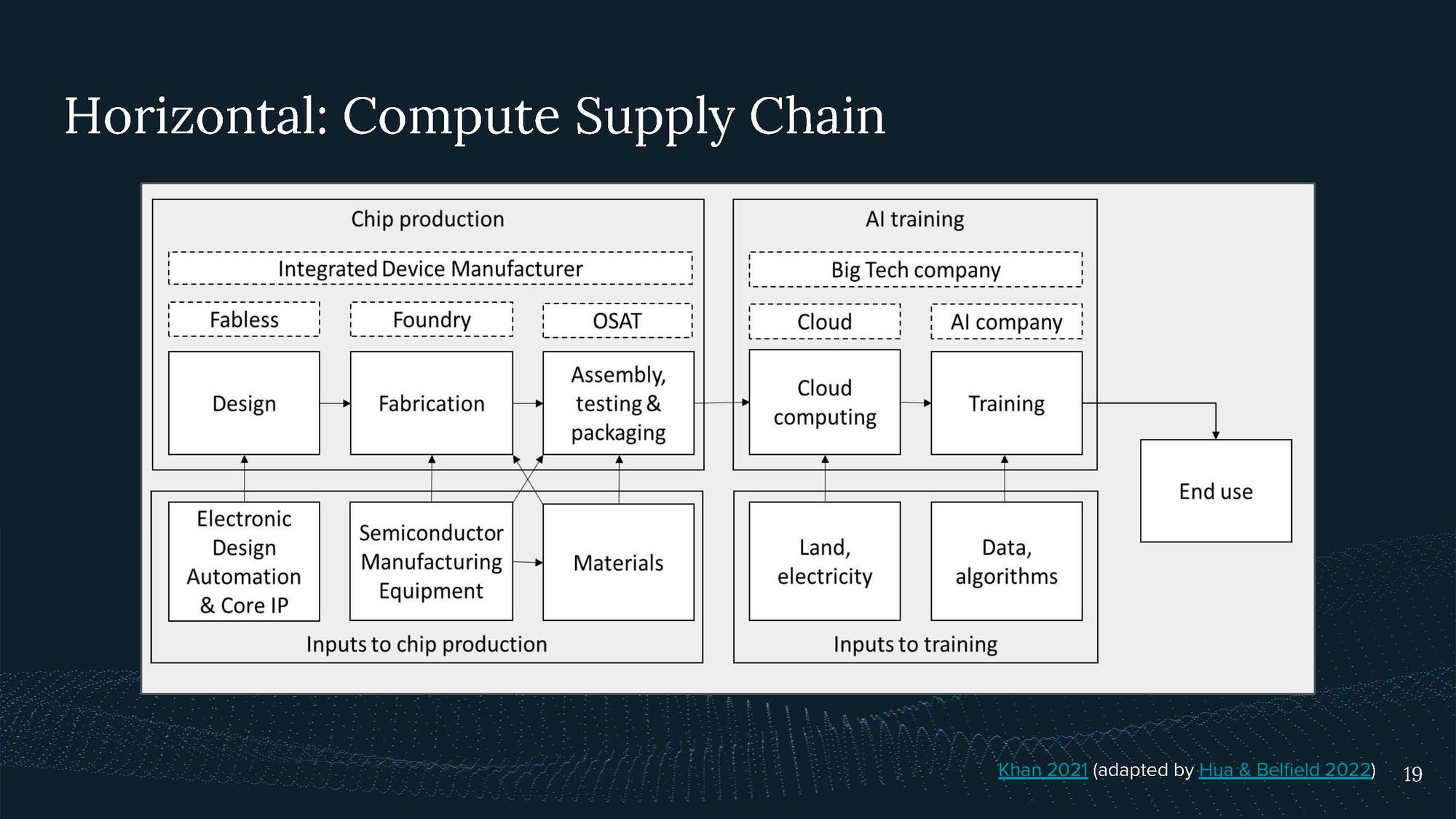

Ao considerar o cenário de governança, podemos observá-lo horizontalmente, em toda a cadeia de suprimentos de computação, e verticalmente, em termos da pilha de tecnologia computacional.

Isto é de Khan 2021 (adaptado por Hua & Belfield 2022 ), e não vou entrar em detalhes aqui.

A cadeia de suprimentos consiste na produção de chips, incluindo design, fabricação, montagem, testes e embalagem, com vários atores proeminentes, como a TSMC e a ASML. Esses chips muitas vezes acabam em grandes empresas de tecnologia ou de computação em nuvem, onde também há concentração significativa em atores como a Amazon Web Services, a Microsoft Azure e a Google Cloud. A computação em nuvem é então usada para treinar sistemas de IA.

Ao governar os sistemas de IA, podemos considerar vários pontos em toda a cadeia de suprimentos, como rastrear a distribuição de chips ou trabalhar com fornecedores de nuvem para implementar o uso responsável do poder computacional e regimes de Conheça seu Cliente (KYC).

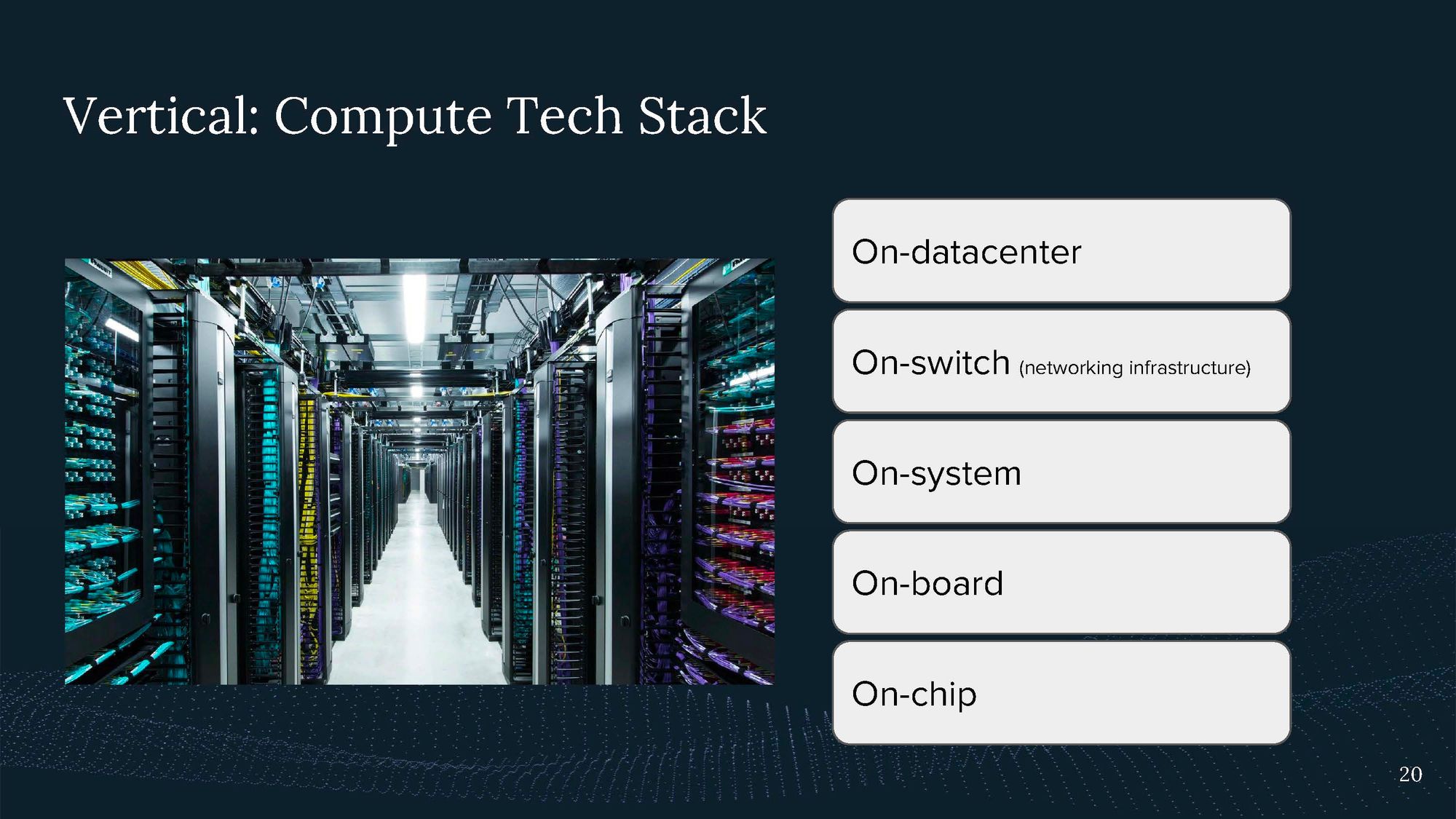

Fico entusiasmado não apenas com a cadeia de suprimentos tradicional e os mecanismos de governança, mas também com a pilha de tecnologia computacional.

Por pilha de tecnologia quero dizer o poder computacional concentrado dentro de uma central de dados e os vários componentes que são construídos uns sobre os outros. Esses componentes podem ter mecanismos capacitados por hardware que forneçam garantias ou verificações, como segurança aprimorada da central de dados para proteção contra acesso físico e virtual ou implementação de limitações nas execuções de treinamento para sistemas de IA no nível da placa ou chip.

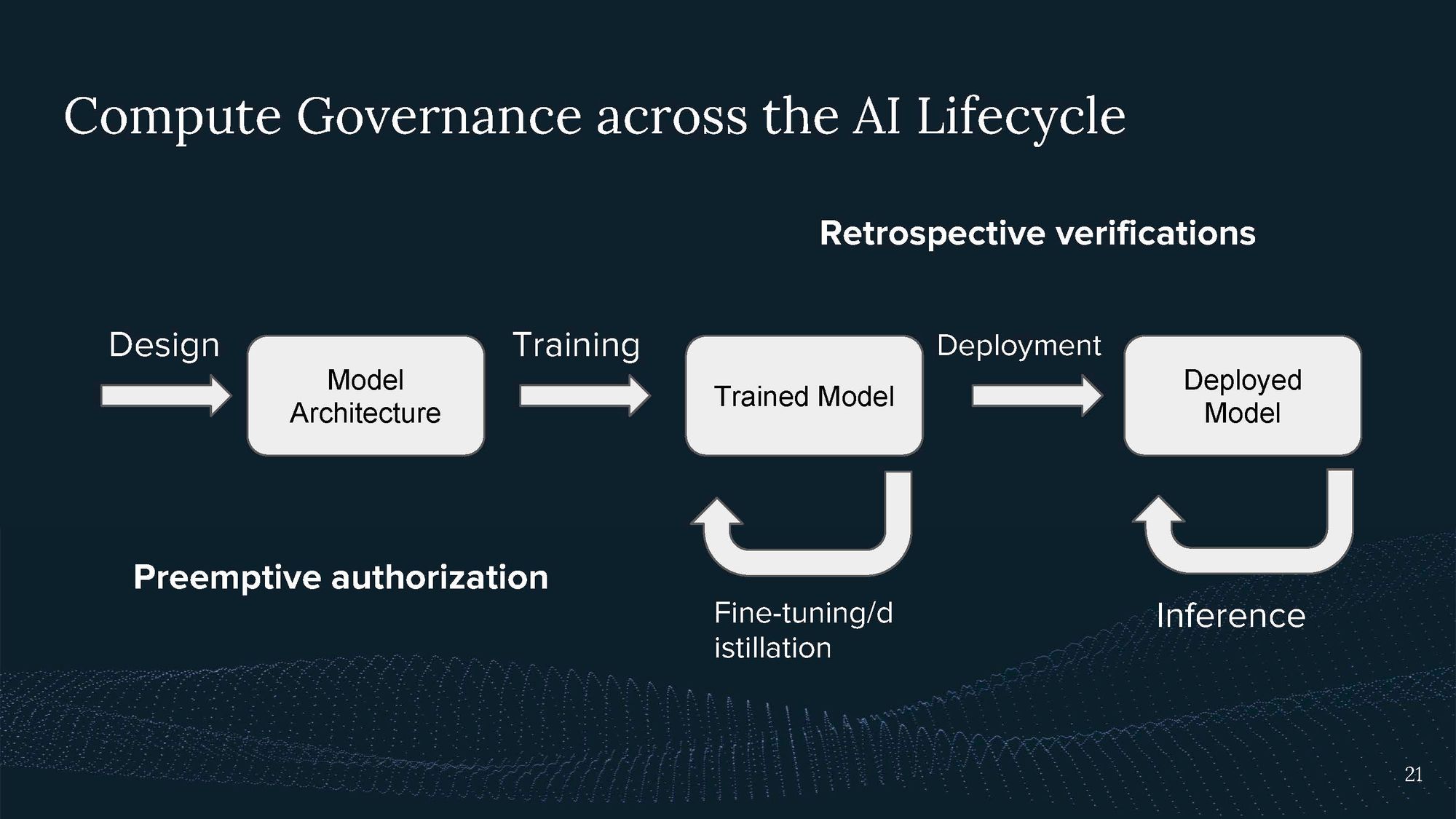

Outro conceito útil a considerar é o ciclo de vida da IA, que inclui design de modelo, treinamento e implementação.

Cada etapa tem diferentes requisitos de poder computacional, sendo o treinamento normalmente o mais exigente. Por exemplo, com a computação que usei para o treinamento, posso executar imediatamente muitas instâncias do meu modelo simultaneamente. Ao regulamentar grandes consumidores de poder computacional, é essencial compreender que parte do ciclo de vida da IA está a sendo regulamentado. Por exemplo, a autorização preventiva pode envolver a limitação do poder computacional de treinamento, enquanto a regulamentação retrospetiva pode se concentrar na identificação de quem treinou e implementou sistemas específicos, o que pode ser útil para a atribuição pós-incidente.

Então meu trabalho é apenas tirar hardware das pessoas?

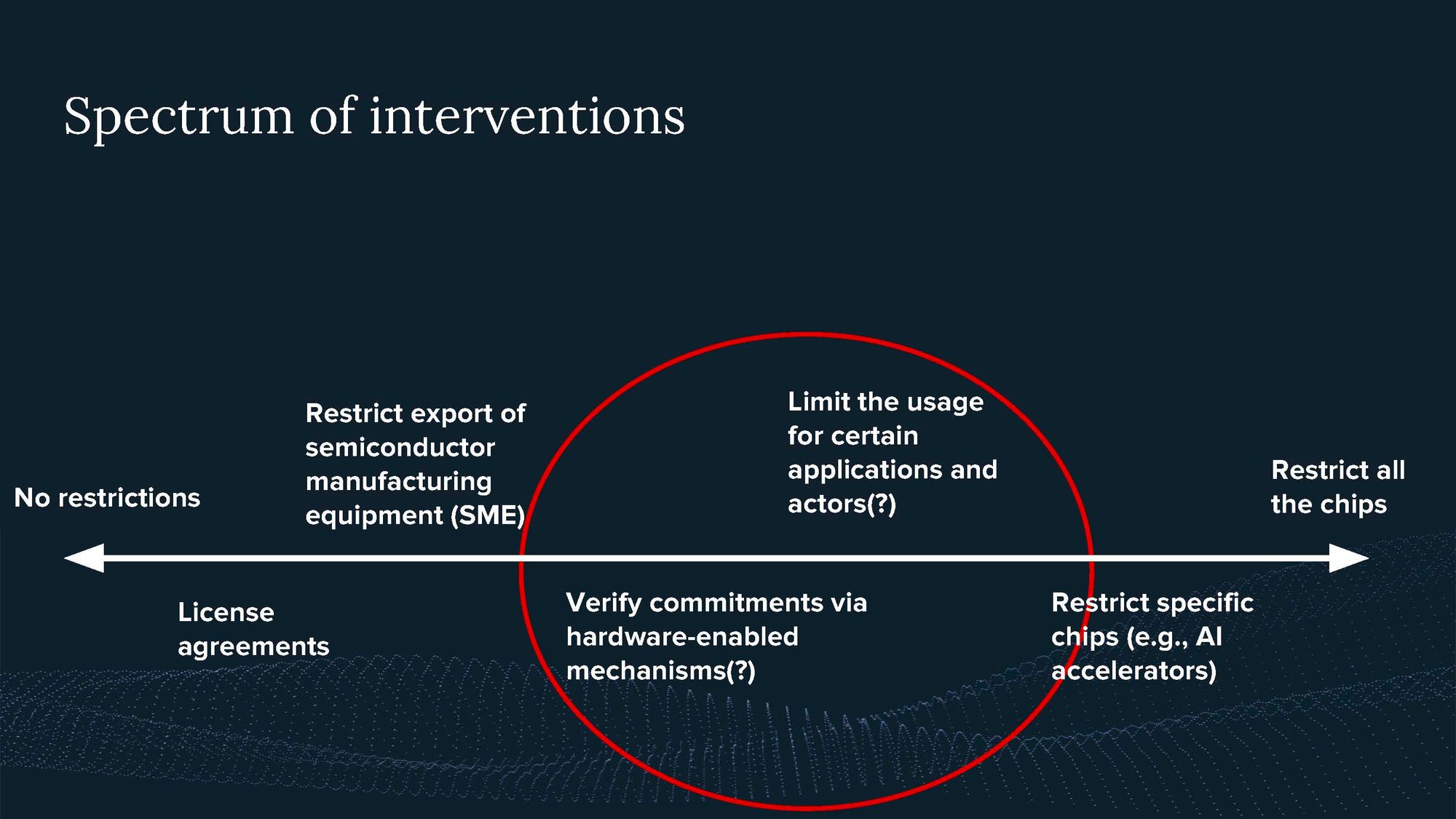

A governança computacional não se limita a duras restrições à exportação. Também pode incluir o que chamam de “diplomacia capacitada por hardware”. Existe um continuum de intervenções, estando do lado mais severo as recentes restrições à exportação.

Vamos dar uma olhada nas restrições à exportação.

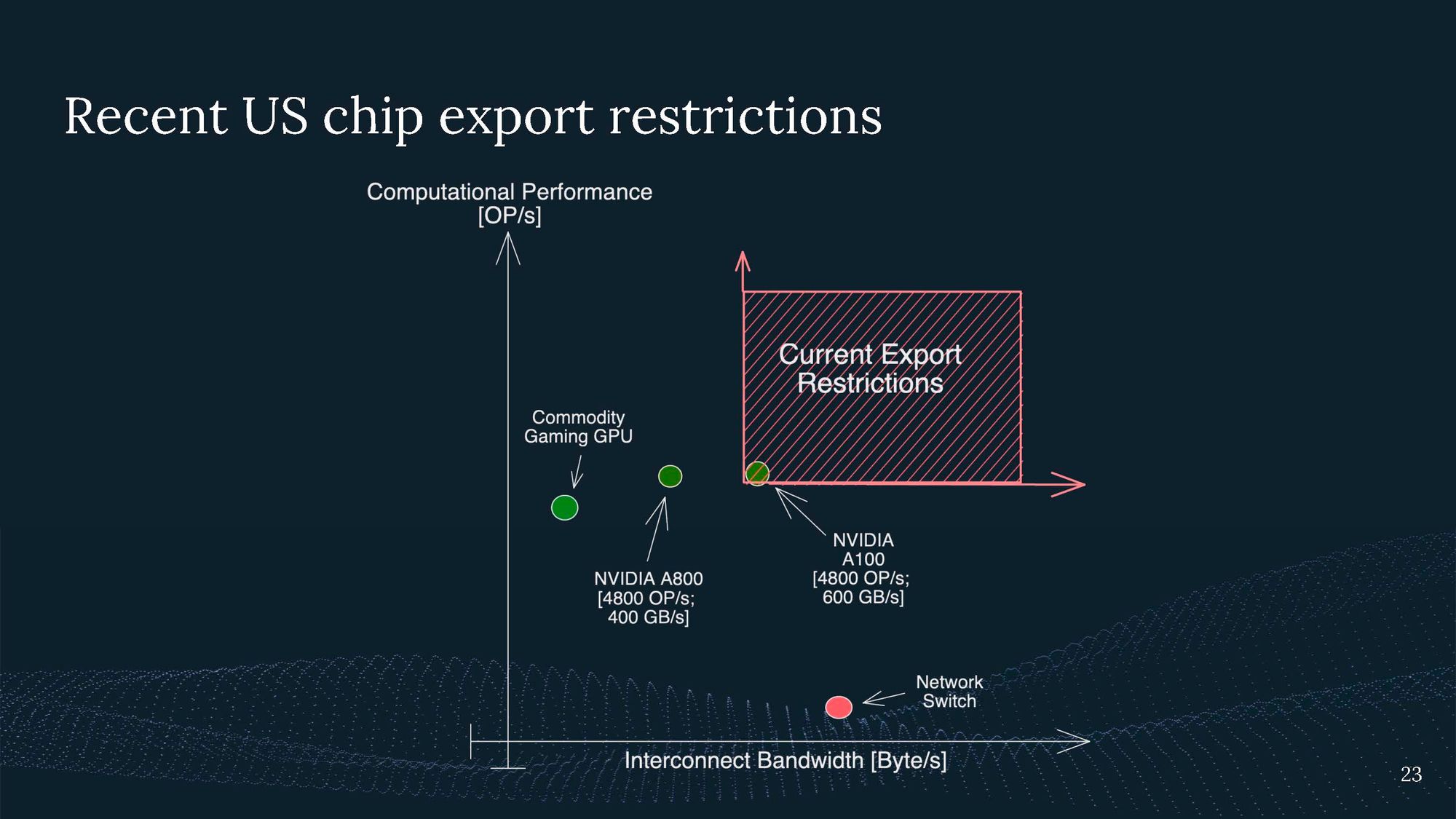

O governo dos EUA impôs intervenções direcionadas para restringir a exportação de chips com desempenho computacional e largura de banda de interconexão específicos, com o objetivo de limitar o desenvolvimento e a utilização de sistemas de IA em determinados países.

Mesmo assim, a NVIDIA respondeu prontamente a isso desenvolvendo um novo chip que atende justamente aos requisitos de exportação, o A800.

Portanto, o que o governo dos EUA tentou fazer foi restringir apenas o hardware específico usado no treinamento de IA, não as GPUs que os os jogadores de videogames normalmente usam.

Ainda assim, estas restrições têm danos colaterais.

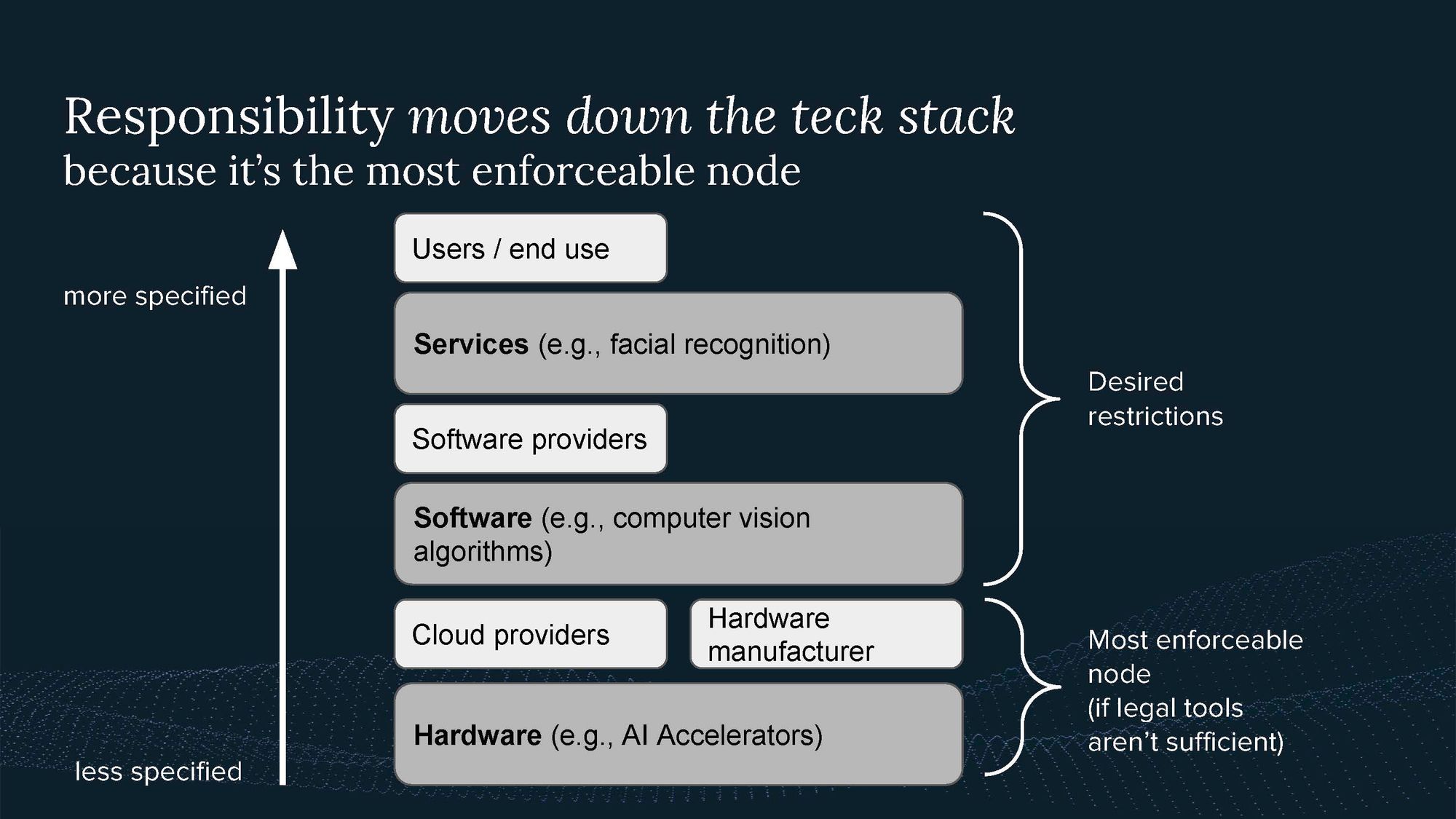

O que o governo dos EUA tenta fazer é impedir o uso do reconhecimento facial para suprimir minorias na China e evitar simulações de armas nucleares. São serviços que nos preocupam. Mas não podemos governá-los diretamente; por isso temos que regulamentar mais abaixo na pilha tecnológica.

A pilha tecnológica, composta por hardware e software, é responsável pela construção de serviços, e a responsabilidade pelas restrições desce na pilha tecnológica quando as ferramentas legais não são suficientes para fazer cumprir as regulamentações. Isso foi visto no passado, p. ex., com autoridades invadindo centrais de dados para encerrar sites ilegais na dark web porque não conseguiam impedir sites de venda de drogas de outra forma.

Você pode pensar nessas diferentes intervenções em um continuum.

Em vez de simplesmente restringir todos os chips, existe potencial para verificar compromissos através de mecanismos de hardware. Isso pode envolver visitar a localização de um chip, utilizar desafios criptográficos para garantir que a sua localização continua inalterada ou mesmo limitar a sua utilização para aplicações específicas, tais como modelação climática ou restringir a sua utilização por determinadas organizações.

Globalmente, a governança computacional pode assumir várias formas, desde restrições à exportação até diplomacia baseada em hardware, e é essencial explorar uma série de opções para garantir a utilização e o desenvolvimento responsáveis de sistemas de IA.

Aqui estou especialmente entusiasmado com:

4. Mecanismos capacitados por hardware

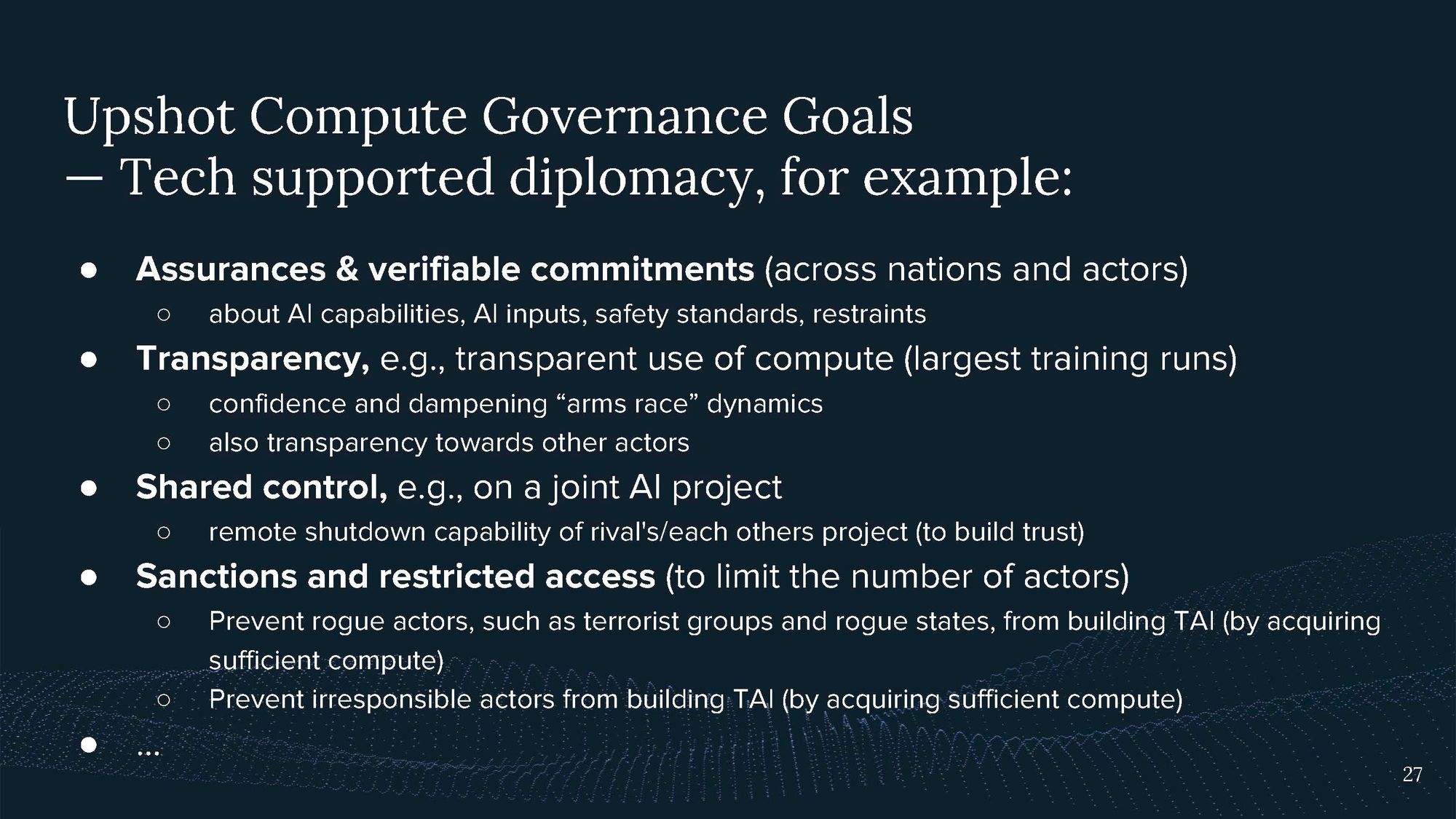

A governança computacional tem o potencial de apoiar a diplomacia assistida pela tecnologia, proporcionando mais garantias e compromissos verificáveis entre nações e setores. A implementação de mecanismos capacitados por hardware pode melhorar a transparência, atenuar dinâmicas de corrida armamentista e facilitar a cooperação no desenvolvimento e utilização de sistemas de IA.

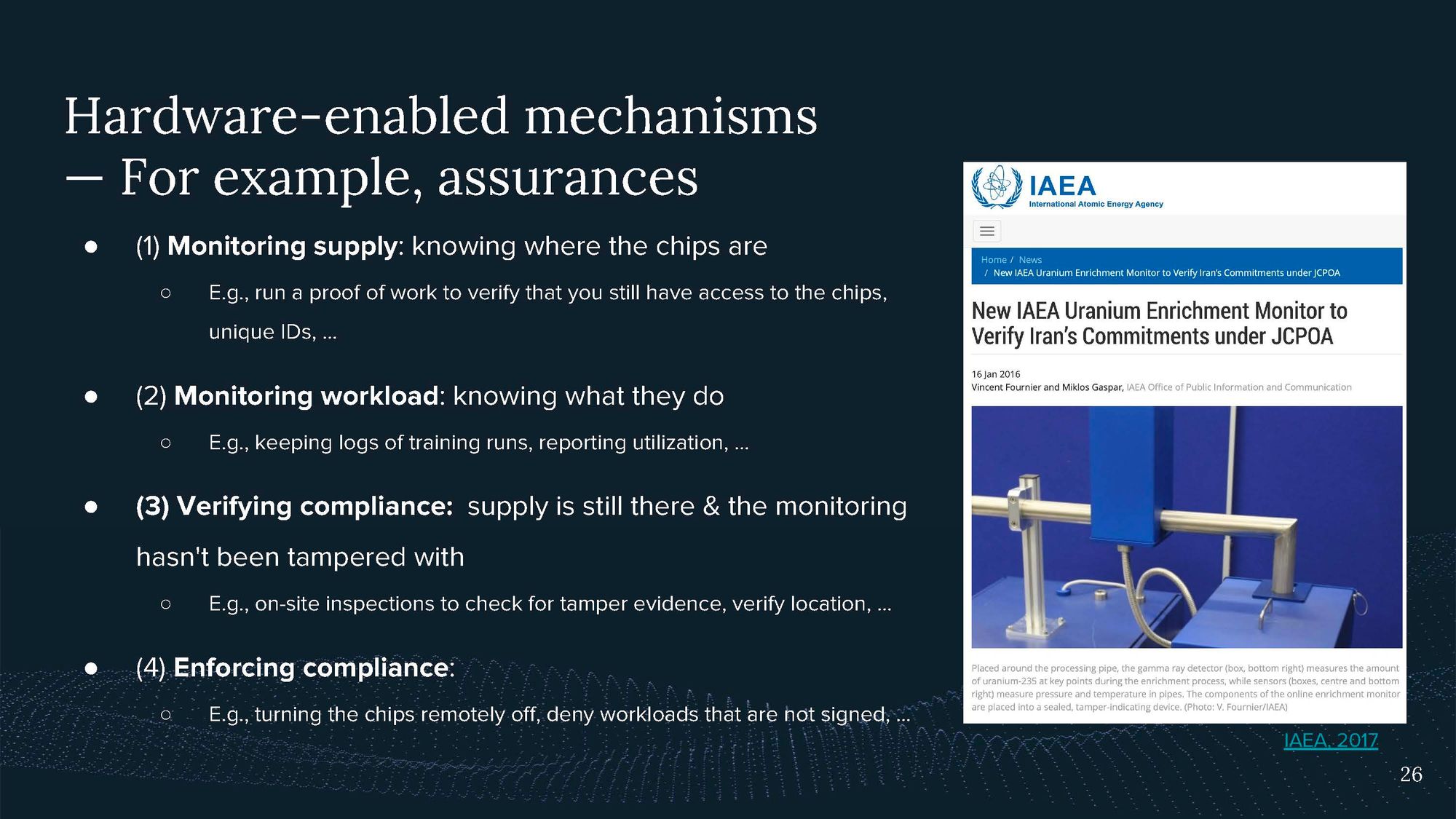

Um exemplo de mecanismos capacitados por hardware que existem hoje incluem os monitores que verificam se as instalações de enriquecimento nuclear do Irã não enriquecem urânio acima de um determinado limite.

Algumas metas potenciais de governança computacional incluem:

- Monitoramento do suprimento de chips: verificar se os atores têm acesso a um determinado número de chips, executando desafios de prova de trabalho ou solicitando IDs exclusivos de chips. Por exemplo, você poderia enviar uma solicitação a uma central de dados para calcular alguma função, e ela teria que devolvê-la em 10 minutos. Dessa forma, você sabe que o hardware ainda está lá.

- Monitoramento de cargas de trabalho: garantir que os sistemas de IA sejam treinados apenas até um determinado tamanho ou dentro de parâmetros específicos.

- Verificação da conformidade: garantir que o monitoramento não foi adulterado, através da realização de inspeções no local ou do uso de ferramentas técnicas para verificar a localização dos chips. Por exemplo, isso poderia ser feito através de inspeções no local.

- Imposição de conformidade: desligar remotamente chips ou negar cargas de trabalho não assinadas, o que pode ajudar a evitar o uso indevido de sistemas de IA.

Alcançar esses objetivos será difícil. Mas acho que poderia ser possível. Eles poderiam permitir:

Os mecanismos propostos poderiam permitir o que chamo de diplomacia sustentada pela tecnologia. Poderiam permitir que diferentes atores cooperassem, assumindo compromissos verificáveis. E isso não diz respeito apenas aos EUA e à China, mas a muitos outros atores.

Neste contexto, a transparência é particularmente importante. Mesmo as superpotências não dominantes em IA devem ser consideradas em cenários que envolvem tecnologia transformadora. Elas ainda poderiam usar a guerra cinética se se sentissem ameaçadas pelas capacidades de IA de outro país.

Uma solução interessante para viabilizar a confiança também poderia ser dar à outra parte a capacidade de desligar o seu computador. Potencialmente, você poderia até estabelecer recursos de computação compartilhados que seriam usados por um projeto internacional com responsabilidade compartilhada.

E, finalmente, você pode, claro, excluir maus atores como terroristas do uso indevido da IA transformadora.

5. Nossa política funciona até agora

Gostaria de discutir o trabalho em políticas em que nossa equipe de políticas está envolvida.

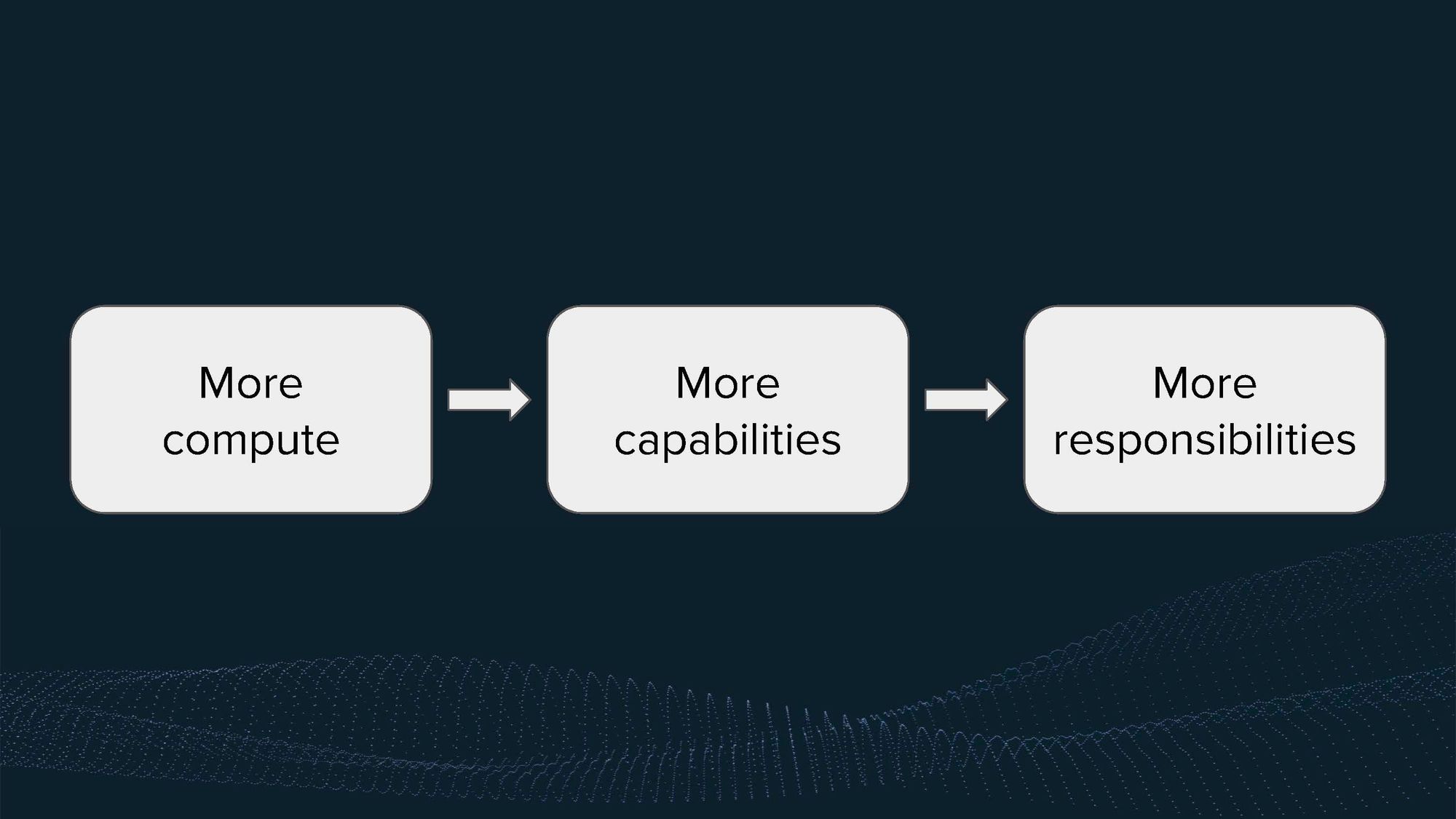

Temos promovido a ideia de que maior poder computacional implica maiores capacidades e, portanto, maior responsabilidade. As leis de amplificação descrevem que o aumento do poder computacional, ou a amplificação, geralmente leva a sistemas mais capazes. Assim, argumentamos que se você usar mais computação, terá mais responsabilidade. Por exemplo, no contexto do Recurso Nacional de Investigação em IA, se os acadêmicos solicitarem mais poder computacional, deverão assumir maior responsabilidade, particularmente no que diz respeito ao processo de publicação e ao código aberto dos seus sistemas.

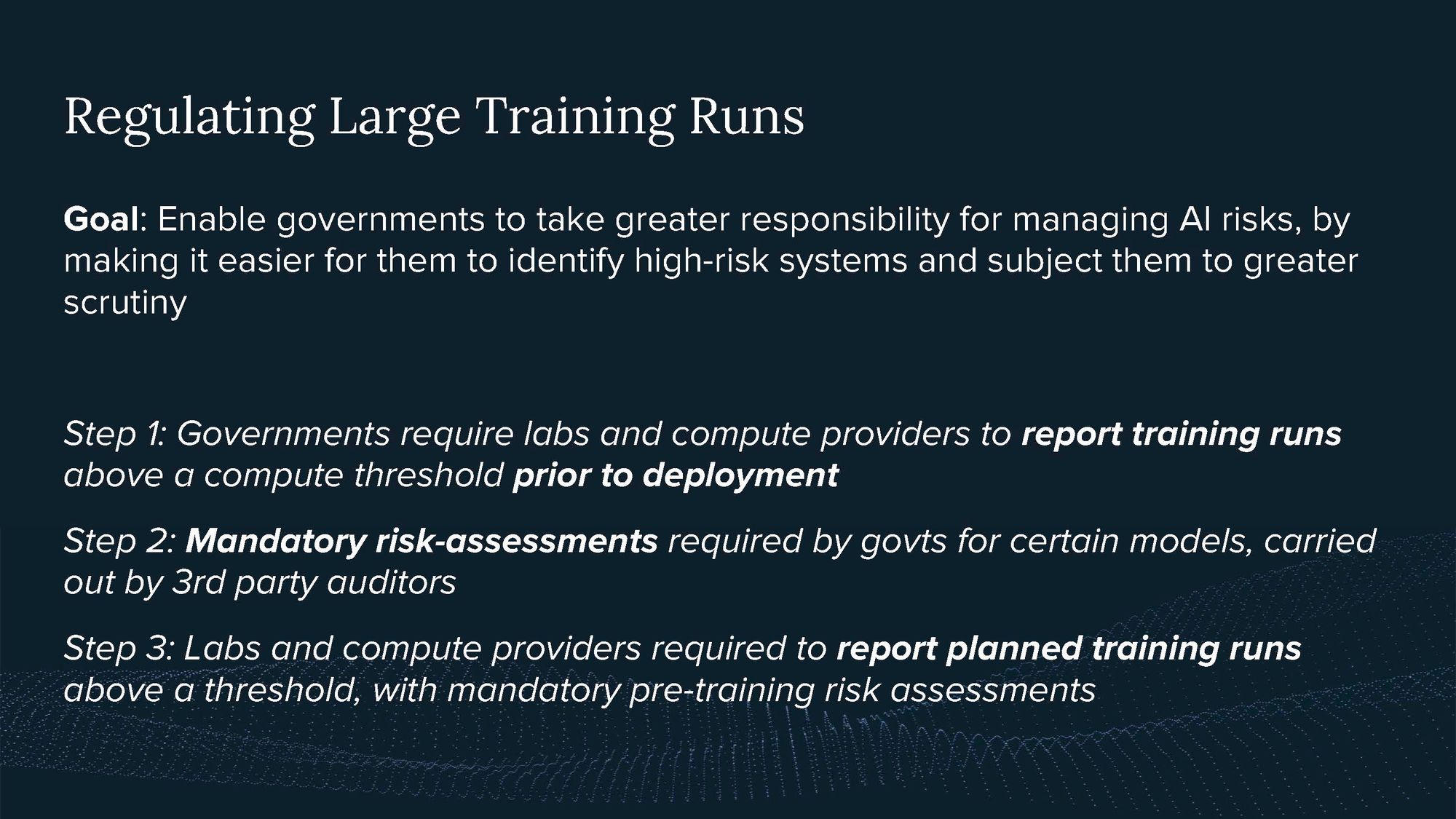

Também temos explorado a regulamentação de grandes execuções de treinamento no contexto do Reino Unido e dos EUA.

O nosso objetivo é permitir que os governos assumam maior responsabilidade na gestão dos riscos da IA e identifiquem precocemente sistemas de alto risco para um maior escrutínio. Imaginamos um processo em camadas que pode ser ampliado ao longo do tempo, se necessário. Inicialmente, os governos poderiam exigir relatórios de treinamentos acima de um determinado limite antes da implementação. Em seguida, as avaliações de risco obrigatórias para modelos maiores poderiam ser realizadas por auditores-terceiros. Por fim, os laboratórios e os fornecedores de computação precisariam relatar execuções de treinamento planejadas acima de um limite específico e buscar avaliação e aprovação obrigatórias de risco pré-treinamento.

Já discutimos fundos computacionais e modelos pré-treinados como exemplos de nosso trabalho nesta área.

- Fundos Computacionais e Modelos Pré-treinados | Blog do GovAI

- Envio de RFI do Recurso Nacional de Pesquisa de IA dos EUA (NAIRR)

- Resposta do GovAI ao Future of Compute Review – Pedido de Evidências

- Grupo de Especialistas em Computação de IA e Clima da OCDE

Resumo

Em resumo, uma governança computacional resiliente é necessária, mas não suficiente por si só; precisa fazer parte de um regime de governança mais amplo. O poder computacional permite acordos internacionais, acordos entre laboratórios e maior capacidade de governança através da intervenção governamental, mas ainda são necessárias ferramentas adicionais para arbitragem.

Ao considerar o poder computacional, concentre-se em suas propriedades fundamentais e esteja ciente do estado de coisas computacionais, que pode mudar. É útil compreender a cadeia de suprimentos e os vários atores envolvidos, tais como fornecedores de computação em nuvem ou empresas de hardware.

A governança computacional já está acontecendo, e por isso é essencial desenvolver e promover ideias melhores antes de tomar decisões sem o conhecimento adequado. A responsabilidade está mudando ao longo da pilha tecnológica, fazendo com que os provedores de poder computacional, especialmente as empresas de nuvem e de hardware, sejam cada vez mais responsáveis pelas capacidades de IA. O acesso ao hardware se traduz em acesso a capacidades de IA, e a imposição de normas torna-se mais desafiadora mais abaixo na pilha.

Para abordar de forma eficaz a governança computacional, o trabalho deve ser feito em todas as frentes, incluindo o domínio técnico. Isso envolve aprender mais sobre hackeamento, desenvolver mecanismos invioláveis e defender a sua implementação em acordos internacionais.

Obrigado pela atenção!

Sobre o autor

Lennart Heim é pesquisador do Centre for Governance of AI em Oxford, com foco em Governança Computacional. Os seus interesses de investigação incluem o papel do poder computacional na produção de IA, a cadeia de suprimentos do poder computacional, a previsão de tecnologias emergentes e a segurança de sistemas de IA. Seu tempo é dividido na análise estratégica e técnica do domínio da governança computacional e no envolvimento político ativo com a equipe de políticas do GovAI.

Ele também é membro do Grupo de Especialistas em IA, Computação de IA e Clima da OCDE, membro do grupo-diretor do Tony Blair Institute for Global Change’s National Compute Index e Especialista em Estratégia da Epoch, uma nova organização focada na pesquisa de questões estratégicas em torno de IA avançada. Tem formação em Engenharia de Computação. Anteriormente, Lennart trabalhou como consultor da OCDE e como pesquisador na ETH Zürich.

Obrigado a Konstantin Pilz por preparar e editar esta transcrição.

Publicado originalmente em 2023 aqui.

Autor: Lennart Heim

Tradução: Luan Marques